-

摘要:

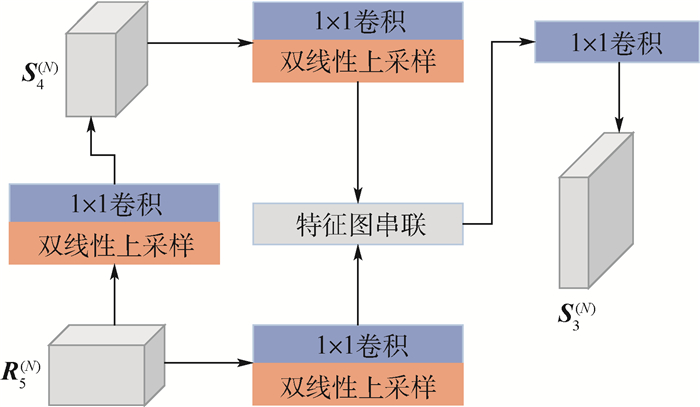

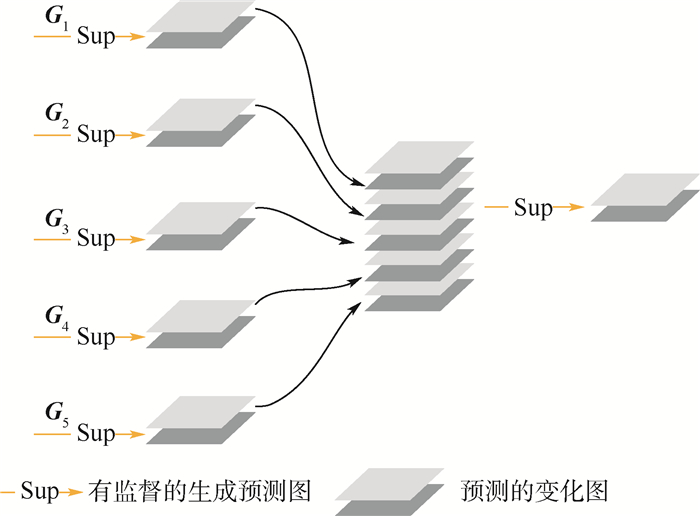

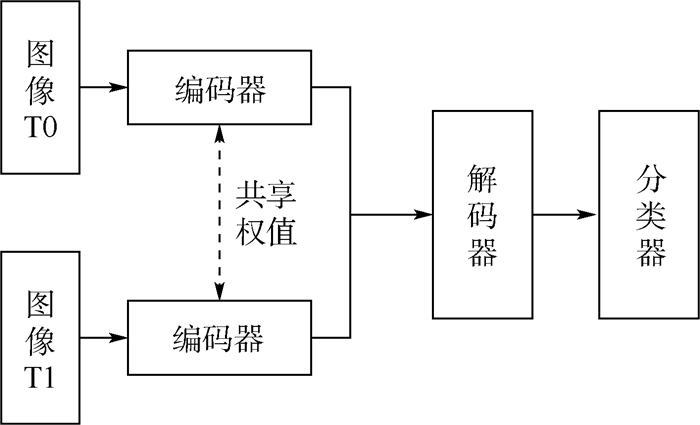

变化检测(CD)是遥感的一项重要任务,通常面临许多伪变化和较大的尺度变化。目前的方法主要侧重于对差异特征的建模,忽略了从原始图像中提取足够的信息,影响了特征的识别能力,难以稳定地区分出变化区域。针对以上问题,提出了一种全尺度特征聚合网络(FFANet)来更充分地利用原始图像特征,促使生成的特征表示在语义上更丰富、在空间上更准确,从而提高了网络对小目标和目标边缘的检测性能。同时,拓展了深监督来结合多尺度的预测图,以促使不同对象在更合适的尺度上进行检测,从而提升了网络对对象尺度变化的鲁棒性。在CDD数据集上,相比于基线网络,所提方法仅增加了1.01×106的参数量,就将

F 1分数提升了0.034。Abstract:Change detection (CD) is an important task of remote sensing, always facing many pseudo changes and large scale variations. However, existing methods mainly focus on modeling difference features and neglect extracting sufficient information from the original images, which affects feature discrimination and makes it difficult to distinguish change regions stably. To address these problems, a full-scale feature aggregation network (FFANet) is proposed to make fuller use of the original image features, which drives the generated feature representations to be semantically richer and spatially more precise, thus improving the network's detection performance for small targets and target edges. Deep supervision is also extended to combine multi-scale prediction maps to drive the detection of different objects at more appropriate scales, thus improving the robustness of the network to object scale variations. On the CDD dataset, our proposed method improves the

F 1-score by 0.034 compared to the baseline network by increasing the number of parameters by only 1.01×106. -

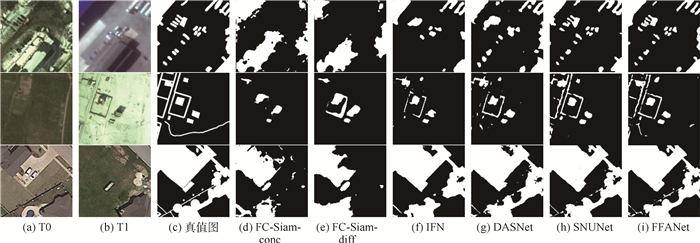

表 1 CDD和LEVIR数据集上FFANet与其他方法的对比

Table 1. Comparison of FFANet with other methods on CDD and LEVIR datasets

方法 参数量/106 计算量/GFLOPs CDD LEVIR P R F1 P R F1 FC-EF 1.35 7.14 0.749 0.494 0.595 0.754 0.730 0.742 FC-Siam-conc 1.55 10.64 0.779 0.622 0.692 0.852 0.736 0.790 FC-Siam-diff 1.35 9.44 0.786 0.588 0.673 0.861 0.687 0.764 IFN 35.72 164.53 0.950 0.861 0.903 0.903 0.876 0.889 DASNet 16.25 113.09 0.914 0.925 0.919 0.811 0.788 0.799 SNUNet 12.03 109.62 0.956 0.949 0.953 0.889 0.874 0.881 FFANet 8.64 28.81 0.962 0.957 0.960 0.925 0.892 0.908 注:GFLOPs指109次浮点运算。 表 2 CDD数据集上的消融实验

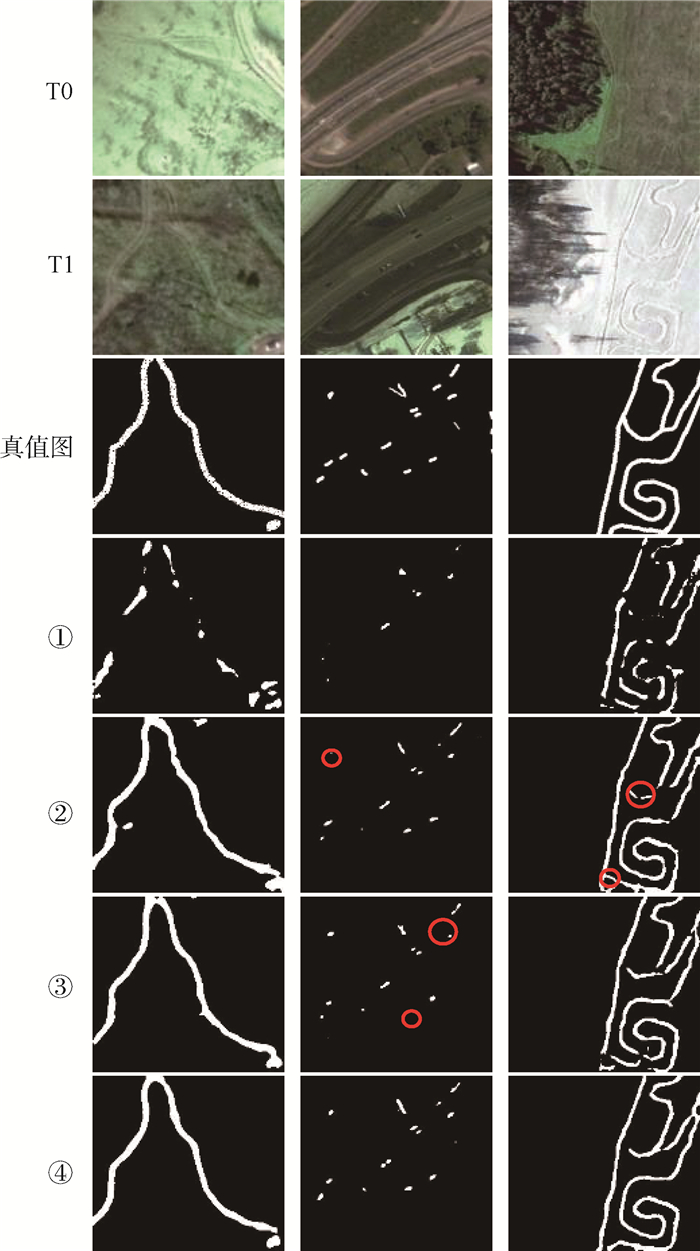

Table 2. Ablation experiments on CDD data set

序号 编码器 分类器 参数量/106 P R F1 ① × × 7.63 0.955 0.900 0.926 ② √ × 8.64 0.960 0.942 0.951 ③ × √ 7.63 0.957 0.943 0.950 ④ √ √ 8.64 0.962 0.957 0.960 -

[1] LEICHTLE T, GEIß C, LAKES T, et al. Class imbalance in unsupervised change detection-A diagnostic analysis from urban remote sensing[J]. International Journal of Applied Earth Observation and Geoinformation, 2017, 60: 83-98. doi: 10.1016/j.jag.2017.04.002 [2] USEYA J, CHEN S B, MUREFU M. Cropland mapping and change detection: Toward zimbabwean cropland inventory[J]. IEEE Access, 2019, 7: 53603-53620. doi: 10.1109/ACCESS.2019.2912807 [3] QIAO H J, WAN X, WAN Y C, et al. A novel change detection method for natural disaster detection and segmentation from video sequence[J]. Sensors (Basel), 2020, 20(18): 5076. doi: 10.3390/s20185076 [4] RONG K, FANG B, CHEN G, et al. Progressive domain adaptation for change detection using season-varying remote sensing images[J]. Remote Sensing, 2020, 12(22): 3815. doi: 10.3390/rs12223815 [5] VU V T, PETTERSSON M I, MACHADO R, et al. False alarm reduction in wavelength-resolution SAR change detection using adaptive noise canceler[J]. IEEE Transactions on Geoscience and Remote Sensing, 2017, 55(1): 591-599. doi: 10.1109/TGRS.2016.2611684 [6] BOVOLO F, BRUZZONE L. A novel theoretical framework for unsupervised change detection based on CVA in polar domain[C]//2006 IEEE International Symposium on Geoscience and Remote Sensing. Piscataway: IEEE Press, 2006: 379-382. [7] DENG J S, WANG K, DENG Y H, et al. PCA-based land-use change detection and analysis using multitemporal and multisensor satellite data[J]. International Journal of Remote Sensing, 2008, 29(15-16): 4823-4838. [8] LI W, LU M, CHEN X W. Automatic change detection of urban land-cover based on SVM classification[C]//2015 IEEE International Symposium on Geoscience and Remote Sensing. Piscataway: IEEE Press, 2015: 1686-1689. [9] DAUDT R C, SAUX B L, BOULCH A. Fully convolutional Siamese networks for change detection[C]//IEEE International Conference on Image Processing (ICIP). Piscataway: IEEE Press, 2018: 4063-4067. [10] ZHANG C Z, PENG Y, TAPETE D, et al. A deeply supervised image fusion network for change detection in high resolution bi-temporal remote sensing images[J]. ISPRS Journal of Photogrammetry and Remote Sensing, 2020, 166: 183-200. doi: 10.1016/j.isprsjprs.2020.06.003 [11] FANG S, LI K Y, SHAO J Y, et al. SNUNet-CD: A densely connected Siamese network for change detection of VHR images[J]. IEEE Geoscience and Remote Sensing Letters, 2021, 19: 1-5. [12] ZHOU Z, SIDDIQUEE M, TAJBAKHSH N, et al. UNet++: A nested U-Net architecture for medical image segmentation[C]// Deep Learning in Medical Image Analysis (DLMIA) Workshop, 2018: 3-11. [13] CHEN H, SHI Z W. A spatial-temporal attention-based method and a new dataset for remote sensing image change detection[J]. Remote Sensing, 2020, 12(10): 1662. doi: 10.3390/rs12101662 [14] CHEN J, YUAN Z Y, PENG J, et al. DASNet: Dual attentive fully convolutional siamese networks for change detection of high resolution satellite images[J]. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 2020, 14: 1194-1206. [15] RONNEBERGER O, FISCHER P, BROX T. U-Net: Convolutional networks for biomedical image segmentation[C]//Medical Image Computing and Compwter-Assisted Intervertion-MICCAI 2015, 2015. [16] SHELHAMER E, LONG J, DARRELL T. Fully convolutional networks for semantic segmentation[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2017, 39(4): 640-651. doi: 10.1109/TPAMI.2016.2572683 [17] LIN T Y, DOLLAR P, GIRSHICK R, et al. Feature pyramid networks for object detection[C]//2017 IEEE Conference on Computer Vision and Pattern Recognition. Piscataway: IEEE Press, 2017: 936-944. [18] BAO T E, FU C Q, FANG T, et al. PPCNET: A combined patch-level and pixel-level end-to-end deep network for high-resolution remote sensing image change detection[J]. IEEE Geoscience and Remote Sensing Letters, 2020, 17(10): 1797-1801. doi: 10.1109/LGRS.2019.2955309 [19] HUAN R, ZHOU M, XING Y, et al. Change detection with various combinations of fluid pyramid integration networks[J]. Neurocomputing, 2021, 437: 84-94. doi: 10.1016/j.neucom.2021.01.030 [20] YANG K, LIU Z, LU Q, et al. Multi-scale weighted branch network for remote sensing image classification[C]//2010 IEEE Conference on Computer Vision and Pattern Recognition. Piscataway: IEEE Press, 2019. [21] LEBEDEV M A, VIZILTER Y V, VYGOLOV OLEG, et al. Change detection in remote sensing images using conditional adversarial networks[J]. The International Archives of the photogrammetry, Rewote Sensing and Spatial Information Sciences, 2018, 48(2): 565-571. -

下载:

下载: